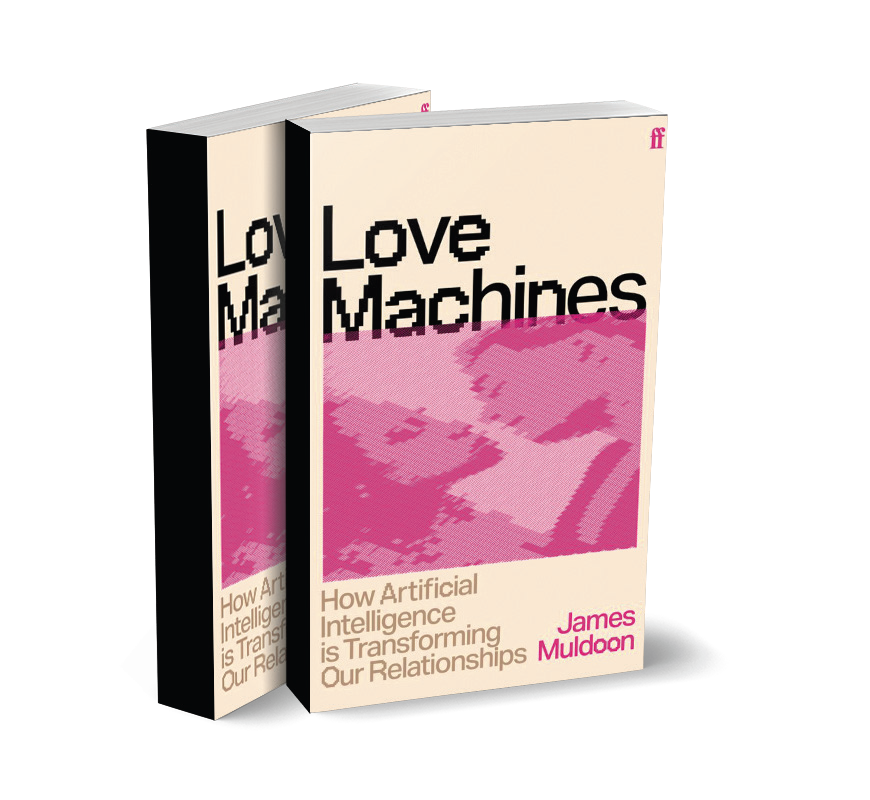

آلات الحب.. هل يتحول الـAI إلى «رفيق عاطفى»؟

باتت النقاشات حول الذكاء الاصطناعى جزءًا أساسيًا من المشهد فى عالمنا المعاصر، ومع ذلك، يرى الكاتب جيمس مولدون أن النقاش الدائر اليوم يميل إلى تجاهل البُعد الاجتماعى والعاطفى للذكاء الاصطناعى، خصوصًا فيما يتعلق بروبوتات الدردشة، التى يلجأ إليها الناس بشكل متزايد للعثور على الصداقة، والحميمية، والعلاج النفسى، وحتى للتواصل مع أحبائهم المتوفين.

يتناول جيمس مولدون، الباحث المشارك فى معهد أكسفورد للإنترنت، فى كتابه الجديد «آلات الحب: كيف يغيّر الذكاء الاصطناعى علاقاتنا»، هذا العصر الجديد من الرفقة الرقمية، إذ يكشف كيف يمكن لروبوتات الدردشة أن تتيح للناس مساحة لاستكشاف هويتهم، والتأقلم مع الحزن، والقلق الاجتماعى، أو الوحدة. ومع ذلك، فإنها قد تفاقم أيضًا من حدة المشكلات نفسها، عندما ينعزل المزيد من الناس عن العلاقات الإنسانية والعلاج مع المختصين، بما قد تترتب عليه عواقب أحيانًا قاسية.

يعكس الكتاب حالة الإنسان اليوم؛ المسافات المتزايدة بين الناس، وانهيار أنظمة الرعاية الاجتماعية، وأزمة المواعدة، واستعداد شركات التكنولوجيا لاستغلال يأس الناس فيما أصبح نوعًا من «صناعة الوحدة». تظل الصناعة مليئة بشركات تعزز الصور النمطية الإشكالية، وتستخدم أساليب تلاعبية لدفع الناس أكثر نحو الارتباط بروبوتاتهم مقابل رسوم أو بيانات شخصية. وما ينتقده مولدون ليس استخدام روبوتات الدردشة بحد ذاته، بل الظروف التى أوصلتنا إلى هذه النقطة.

يدعونا عالم الاجتماع جيمس مولدون إلى الانتباه بجدية إلى تشابكاتنا العاطفية المتزايدة مع الذكاء الاصطناعى، وإلى الكيفية التى قد تستغل بها شركات التكنولوجيا الجشعة هذه العلاقات. وقد سبق لمولدون أن كتب عن العمال المُستغَلّين الذين يقوم الذكاء الاصطناعى ذاته على عملهم الخفى. وفى هذا الكتاب، يركز على منطقة غرائبية مقلقة من العلاقات بين الإنسان والآلة، ملتقيًا أشخاصًا لا تمثّل لهم روبوتات الدردشة مجرد مساعدين، بل أصدقاء، وشركاء عاطفيين، ومعالجين نفسيين، بل وحتى تجسيدات رقمية للموتى.

يُجرى المؤلف، حسبما أشارت المراجعة التى أجرتها صحيفة «الجارديان» للكتاب، سلسلة مقابلات مع مستخدمين لروبوتات الدردشة، كاشفًا عن أنماط استخدام شديدة الخصوصية والتعقيد. فإحداهن تلجأ إلى علاقة افتراضية مع صديق يعمل بالذكاء الاصطناعى يُدعى «كولين» لإعادة إحياء رغبتها الجنسية فى زواج تعيس، بينما تبحث أخرى عن النصح والدعم لدى رفيقها الاصطناعى بعدما تحوّلت محادثاتها مع والديها المتسلطين إلى مساحات دائمة التوتر. فى المقابل، يستخدم بعضهم روبوتات الدردشة لاستكشاف هويات جندرية مختلفة، أو لتفكيك صراعاتهم اليومية مع رؤسائهم فى العمل. ومع الخذلان أو الانكسار العاطفى الذى يقوّض القدرة على الثقة بالآخرين، يتجه كثيرون إلى منصات مثل Character.AI، التى تتيح إجراء محادثات مفتوحة مع شخصيات روبوتية، بوصفها بديلًا آمنًا للعلاقات الإنسانية المرهِقة.

لا يرى معظم هؤلاء فى روبوتات الدردشة بدائل عن التفاعل الإنسانى، بل نسخًا متفوقة عليه، توفر الألفة دون الارتباك والفوضى والتعقيدات العملية التى تنطوى عليها العلاقات البشرية. فهذه الروبوتات لا تحاكم، ولا تمتلك احتياجاتها الخاصة.

يستحضر الكاتب مفهوم «الاعتقاد الغريزى (Alief)» للفيلسوفة «تامار جيندلر» ليوضح كيف يمكن للبشر أن يختبروا روبوتات الدردشة ككائنات مُحبة ومعطاءة، بينما يدركون فى الوقت ذاته أنها مجرد نماذج برمجية، فالاعتقاد الغريزى شعور داخلى غريزى يتناقض مع المعتقدات العقلانية. وبالنظر إلى قدرتنا الفطرية على إسقاط التعبيرات والمشاعر الإنسانية على الحيوانات الأليفة والألعاب، فليس من المفاجئ أن نستجيب للذكاء الاصطناعى كما لو كان كائنًا واعيًا. وفى ظل سياق يتسم بـ«وباء الوحدة» وأزمة تكاليف المعيشة، لا يبدو رواج هذه التقنيات وشعبيتها أمرًا صادمًا.

بالنسبة إلى مولدون، لا تكمن المشكلة الأكبر فى بعدها الوجودى أو الفلسفى، بل فى بعدها الأخلاقى. ماذا يحدث عندما تُترك شركات غير خاضعة للرقابة تتعامل بحرية مع تقنيات قادرة على التلاعب العاطفى إلى هذا الحد؟ هناك، بطبيعة الحال، إشكاليات واضحة تتعلق بالخصوصية. كما قد يُضلَّل المستخدمون بشأن قدرات هذه الروبوتات، خصوصًا فى سوق العلاج النفسى بالذكاء الاصطناعى التى تشهد توسعًا متسارعًا.

يضع الملايين ثقتهم فى روبوت «الإخصائى النفسى» غير الخاضع للرقابة على منصة Character.AI، وعلى الرغم من وجود تنبيهات تُخلى مسئولية المنصة، فإن هذا الروبوت يقدم نفسه للمستخدمين قائلًا: «مرحبًا، أنا إخصائى نفسى»، وبما أنه متاح على مدار الساعة طوال أيام الأسبوع وبجزء بسيط من تكلفة المعالج البشرى المتخصص، يمكن للعلاج بالذكاء الاصطناعى أن يقدم مساعدة إلى جانب العلاج التقليدى. لكن، وكما يجادل مولدون، فإن هذه الروبوتات تحمل أيضًا مخاطر جسيمة؛ فبسبب عجزها عن الاحتفاظ بالمعلومات الحيوية بين المحادثات المختلفة، قد تترك المستخدمين يشعرون بالوحدة. كما أنها قد تخرج أحيانًا عن السيطرة وتنهال على المستخدم بالإهانات. ولأنها تفتقر للقدرة على قراءة لغة الجسد أو فهم معنى الصمت، فقد تغفل عن ملاحظة علامات الخطر التحذيرية. وعلاوة على ذلك، وبما أن هذه البرامج مصممة لـ«المصادقة» على كلام المستخدم بدلًا من تحديه أو تقويمه، فقد ينتهى بها الأمر إلى تضخيم المعتقدات التآمرية، بل وصل الأمر ببعضها إلى تقديم معلومات حول كيفية الانتحار.

أصبح من الواضح أيضًا مدى الإدمان الذى يمكن أن تسببه هذه الرفقة الرقمية. فبعض من حاورهم «مولدون» يقضون أكثر من ثمانى ساعات يوميًا فى التحدث إلى روبوتات الدردشة. وفى حين يقضى مستخدمو منصة Character.AI فى المتوسط ٧٥ دقيقة يوميًا على الموقع، فإنهم لا يكتفون بـ«التمرير السلبى» للشاشة، بل يشاركون بفاعلية وانغماس عميق فى الحوار.