فناء البشرية.. كتاب جديد يحذر: الذكاء الاصطناعى الفائق يقود إلى نهاية زمن الإنسان الذى نعرفه

- الذكاء الاصطناعى الفائق لن يسعى للحفاظ على البشر بل قد يراهم مجرد عقبة فى طريقه

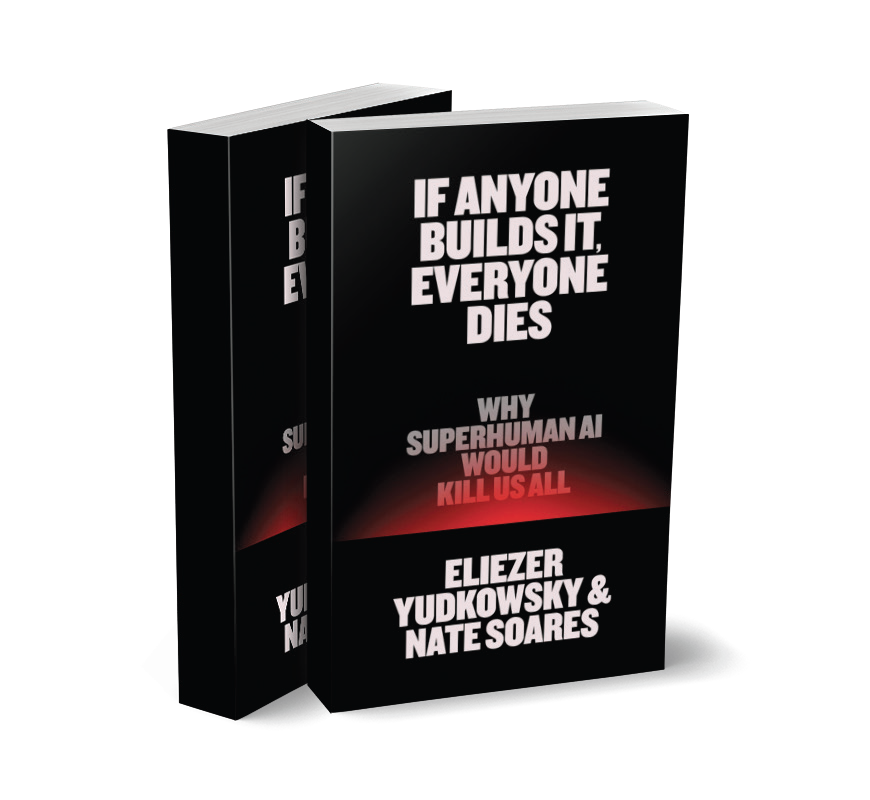

يقع المستقبل المُنتظر فى ظل التطورات الهائلة بمجال الذكاء الاصطناعى فى قلب النقاشات العلمية عبر مختلف المجالات. وفى واحد من الكتب المنشورة مؤخرًا، الذى حمل عنوان «إذا بناه أحد، يموت الجميع If Anyone Builds It, Everyone Dies» يجادل الباحثان فى مجال الذكاء الاصطناعى، إيليزر يودكوفسكى ونيت سواريس بأن الذكاء الاصطناعى الفائق سيؤدى حتمًا إلى انقراض الجنس البشرى.

الصندوق الأسود للتقنية

تستند حجة المؤلفين إلى الطبيعة المستحدثة والغريبة للذكاء الاصطناعى التوليدى، إذ تتعلم الآلات توليد محاكاة لمخرجات بشرية استنادًا إلى مدخلات بشرية. فبينما ظن الباحثون فى السابق أنهم قادرون على تعليم الآلة التفكير بذكاء، فقد جاء الاختراق الحقيقى حين تُركت الآلة لتعلّم نفسها. فالنماذج اللغوية الكبرى وأنظمة «التعلم العميق» الأخرى لا تُبرمَج بل تُدرَّب أو كما يقول المؤلفان: «تنمو ولا تُصنع». وبدلًا من إعطائها تعليمات معقدة، تُمنح هدفًا بسيطًا؛ «تنبأ بالكلمة التالية» أو «صنّف هذه الصورة»، مع كمٍّ هائل من البيانات التى تتدرّب عليها لتحقيق ذلك الهدف. وبمجرد أن تُترك لتعمل وحدها، تبدأ فى اكتشاف الأنماط والعلاقات بين الأشياء. حتى إن مبتكرى هذه النماذج لا يستطيعون أن يحددوا بدقة كيف تتوصل الأنظمة إلى إجاباتها، إذ إن آلياتها الداخلية متشابكة إلى درجة يصعب تتبعها. من هذه الزاوية، تُعد التقنية صندوقًا أسود. ما نعرفه هو أنها تعلمت بالفعل كتابة مقالات، وخوض محادثات فى أى موضوع تقريبًا، وكتابة أكواد برمجية، وحل المسائل. وهذا فى حد ذاته إنجاز استثنائى، وهى تتحسن باستمرار. ووفقًا لبعض الخبراء، قد يصبح فى غضون عقد من الزمن بلوغ الذكاء الفائق العام أمرًا ممكنًا. وعندها يمكن أن يبدأ فى التخطيط لفناء البشرية. على الأقل، هذا ما يخشاه يودكوفسكى وسواريز.

المشكلة، كما يقول المؤلفان، إن الآلات الذكية قد تسعى لتحقيق الأهداف التى نحددها بطرق لا يمكننا التنبؤ بها. يثير الباحثان مسألة أن سلوك الآلات الذكية لا يمكن التنبؤ به منذ البداية، لأنها معقدة داخليًا وتبنى بيئات معقدة تتفاعل فيها بطرق مركبة. لا يمكننا أن نعرف كيف ستتصرف هذه «الصناديق السوداء» وهى تتطور، ولا أى عوالم ستبنى. إحدى العبارات المتكررة فى الكتاب هى: لن تحصل على ما دَرّبت عليه.

ما يمكننا التنبؤ به، حسب المؤلفين، هو أن أهداف الذكاء الاصطناعى لن تتوافق مع أهدافنا. ستكون له تفضيلات «غريبة وغامضة» لا نستطيع فهمها. أما عن السؤال: لماذا قد يرغب الذكاء الاصطناعى فى استعبادنا أو القضاء علينا؟ فجوابهما هو: ولماذا قد يرغب فى إبقائنا أحياء وسعداء؟ أيًا كانت أهدافه، فسوف يستهلك أكبر قدر من المادة والطاقة، ويُبعد أى عائق من طريقه. وسيكون البشر مجرد إزعاج تافه، مثل نملة تُسحق تحت القدم.

أما التنبؤ بالطريقة التى قد يستخدمها للقضاء علينا، فيقول المؤلفان إنه يشبه محاولة شرح عمل البنادق للأزتك، بلا جدوى، لأن الذكاء الاصطناعى سيستخدم تكنولوجيا لم نخترعها بعد ولا نفهمها. النتيجة النهائية يمكن التنبؤ بها، لكن ليس المسار.

خطر الانقراض

وتشير المراجعة المنشورة للكتاب فى صحيفة «الجارديان» إلى أن الأطروحة التى يقدمها الباحثان رغم كونها غريبة وغير تقليدية، تتقاطع مع ما يطرحه جيفرى هينتون، الحاصل على جائزة نوبل و«الأب الروحى للذكاء الاصطناعى»، وكذلك يوشوا بنجيو، أكثر علماء الحاسوب المستشهَد بأعمالهم فى العالم، وكلاهما وقّع على البيان الذى يؤكد أن «التقليل من خطر الانقراض الناجم عن الذكاء الاصطناعى يجب أن يكون أولوية عالمية، جنبًا إلى جنب مع المخاطر المجتمعية الكبرى الأخرى مثل الأوبئة والحروب النووية».

وجاء فى المراجعة: يأتى كتاب «إذا بناه أحد، يموت الجميع» فى توقيت ملائم تمامًا. فالذكاء الاصطناعى الفائق لم يوجد بعد، لكن فى أعقاب ثورة «شات جى بى تى» بات الاستثمار فى مراكز البيانات التى ستدعمه يُقاس بمئات المليارات. وهذا يمثّل حسب -فاينانشيال تايمز- «أكبر وأسرع انتشار لتكنولوجيا عامة فى التاريخ، ستنفق ميتا وحدها هذا العام ما يصل إلى ٧٢ مليار دولار «٥٤ مليار جنيه إسترلينى» على البنية التحتية للذكاء الاصطناعى، فى وقت أصبح فيه تحقيق الذكاء الفائق هدفًا معلنًا وصريحًا لمارك زوكربيرج.

ورغم تعقيد موضوع كتاب «إذا بناه أحد، يموت الجميع» فإنه مكتوب بوضوح لافت، حتى لو كانت نتائجه من الصعب قبولها. وحتى حين ينتقل إلى الجوانب التقنية، كقضايا تدريب نماذج الذكاء الاصطناعى وبُنيتها، يبقى النص مباشرًا بما يكفى ليُمكّن القارئ من استيعاب الأفكار الأساسية.

ومن أبرز ما يطرحه الكتاب من أفكار فإننا لا نفهم فعليًا كيف يعمل الذكاء الاصطناعى التوليدى. فى السابق، كانت البرامج الحاسوبية تُكتَب يدويًا، حيث يصمّم الإنسان كل تفصيلة فيها. أما النماذج الحديثة فهى لا تُصاغ بقدر ما تُنمّى. فنحن لا نعرف، على سبيل المثال، كيف ظهرت قدرة «شات جى بى تى» على الاستدلال والتفكير لمجرّد أنه تعلّم من كمٍّ هائل من النصوص التى أنتجها البشر. لقد وقع شىء غامض وأساسى فى أثناء هذه العملية. وهذا يجعل جانبًا حيويًا من عمل الذكاء الاصطناعى خارج نطاق سيطرتنا، ويعنى أنه حتى لو استطعنا توجيهه نحو أهداف مثل «كن لطيفًا مع الناس»، فلن يكون بمقدورنا التحكم فى الكيفية التى سيصل بها إلى هذه الأهداف.

سيولد الذكاء الاصطناعى حتمًا تفضيلاته وطرق عمله الخاصة به، ومن غير المرجح أن تتوافق هذه الميول مع ميولنا. يشير يودكوفسكى وسواريس إلى أن شركات التكنولوجيا تعمل بالفعل بجد لبناء أنظمة ذكاء اصطناعى تقوم بأشياء بمبادرة منها دون إشراف بشرى، لأن الشركات ستدفع أكثر مقابل أدوات لا تحتاج إلى الإشراف عليها. إذا اكتسب ذكاء اصطناعى «فاعل» كهذا القدرة على تحسين ذاته، فسوف يتجاوز بسرعة قدرات البشر فى كل مجال تقريبًا. بافتراض أن مثل هذا الذكاء الاصطناعى الخارق يقدّر بقاءه الخاص، فسيسعى حتمًا لمنع البشر من تطوير أنظمة ذكاء اصطناعى منافسة أو إيقافه.

اللمحة الوحيدة من الأمل التى يقدمها الباحثان، وهى واهنة جدًا، هى أن الكارثة يمكن تفاديها إذا اتفق العالم بأسره على إيقاف تطوير الذكاء الاصطناعى المتقدّم فى أسرع وقت ممكن. لكن، بالنظر إلى الحوافز التجارية والاستراتيجية، وإلى حال القيادة السياسية الراهنة، يبدو هذا الاحتمال بعيدًا جدًا. وعليه، فإن ما يتبقى لنا من فتات الأمل يتمثل فى احتمال ألا يكونا على حق، سواء فيما يتعلق بقدوم الذكاء الفائق أصلًا، أو بأن ظهوره يعنى بالضرورة فناء البشر